ویتالیک بوترین: باید از هوش مصنوعی برای تقویت حکمرانی دائوها استفاده کنیم!

ویتالیک بوترین پیشنهاد کرده است که مدلهای زبان بزرگ (LLM) میتوانند به عنوان دستیار شخصی برای رأیگیری در سازمانهای غیرمتمرکز، اطلاعات مرتبط را جمعآوری و تصمیمات کاربران را بر اساس ترجیحات آنها انجام دهند.

خلاصه خبر

- اگر ایجنت از رأی دادن در موضوعی مطمئن نباشد، باید مستقیماً از کاربر سوال کند.

- این سیستم میتواند با حفظ حریم خصوصی، امکان استفاده از دادههای حساس و شخصی را فراهم کند.

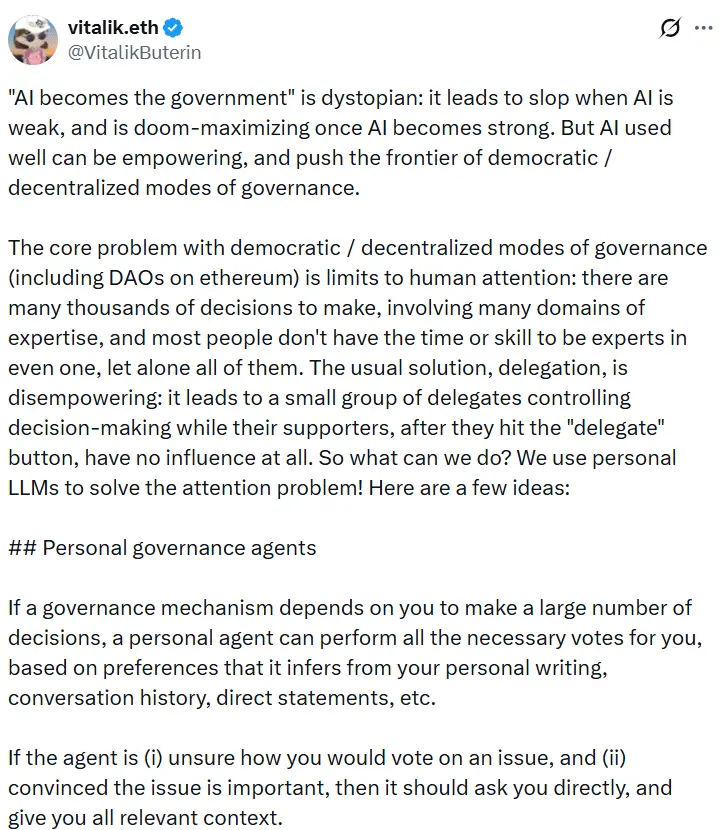

به گزارش کوین تلگراف، ویتالیک بوترین پیشنهاد کرده است که مدلهای زبان بزرگ (LLMها) میتوانند به عنوان دستیار شخصی با فراهم کردن اطلاعات مرتبط مورد نیاز برای رأیگیری، به حل «مشکل توجه» کمک کنند.

او گفت:

اگر یک سازوکار حکمرانی به شما وابسته باشد تا تعداد زیادی تصمیم بگیرید، یک ایجنت شخصی میتواند تمام رأیهای لازم را برای شما، بر اساس ترجیحاتی که از نوشتههای شخصی، تاریخچه مکالمات و اظهارات مستقیم شما استنباط میکند، انجام دهد.

بوترین افزود:

اگر ایجنت در مورد نحوه رأی دادن شما در یک موضوع مطمئن نبود و متقاعد شد که موضوع مهم است، باید مستقیماً از شما بپرسد و تمام اطلاعات مرتبط را به شما بدهد.

لین رتیگ، پژوهشگر بنیاد نیر متخصص در هوش مصنوعی و حکمرانی، سال گذشته گفته بود که این سازمان غیرانتفاعی در حال کار بر روی ایدهای مشابه بود: دوقلوهای دیجیتالی مجهز به هوش مصنوعی که به نمایندگی از اعضای DAO رأی میدهند تا مشارکت پایین رأیدهندگان را جبران کنند.

به گفته بوترین، چالش دیگری در حکمرانی بسیار غیرمتمرکز زمانی پدیدار میشود که تصمیمات کلیدی به اطلاعات خصوصی یا حساس، مانند مذاکرات، اختلافات داخلی یا انتخابهای بودجه، وابسته باشند. او گفت:

معمولاً، سازمانها این مشکل را با انتصاب افرادی که قدرت زیادی برای انجام آن وظایف دارند، حل میکنند. یک راه حل جایگزین میتواند این باشد که کاربران LLM شخصی خود را به یک جعبه سیاه ارائه دهند، LLM اطلاعات خصوصی را میبیند، بر اساس آن قضاوت میکند و فقط آن قضاوت را خروجی میدهد. شما اطلاعات خصوصی را نمیبینید و هیچ کس دیگری محتویات LLM شخصی شما را نمیبیند. همه این رویکردها شامل استفاده هر شرکتکننده از اطلاعات بسیار بیشتری در مورد خودشان و احتمالاً ارائه ورودیهای با اندازه بسیار بزرگتر است. بنابراین، حفاظت از حریم خصوصی اهمیت بیشتری پیدا میکند.